Em fevereiro de 2026, a Inteligência Artificial deixou definitivamente o campo das hipóteses e passou a ocupar o centro de fraudes bilionárias. E os criminosos vêm utilizando da IA para forjar documentos, criar identidades sintéticas e estruturar pedidos de crédito fraudulentos em larga escala. Só para exemplificar, há o caso do Commonwealth Bank of Australia (CBA), em que empréstimos suspeitos podem chegar a US$ 1 bilhão em fraudes – volume que levou a instituição a acionar a polícia e reforçar seus protocolos de segurança.

Na mesma direção, um dos episódios mais emblemáticos do uso malicioso da IA envolveu um deepfake que enganou funcionários de uma empresa de engenharia no Reino Unido. Acreditando participar de uma videoconferência com executivos legítimos, a equipe autorizou transferências que resultaram em um prejuízo de US$ 25 milhões. O caso foi citado pelo The New York Times e debatido no Fórum Econômico Mundial.

Os dois episódios mostram que o uso malicioso da Inteligência Artificial não é mais cenário futurista. É risco concreto, com impacto financeiro, reputacional e potencial reflexo direto sobre consumidores – e empresas. Isso, inclusive, é o que mostra o relatório Disrupting Malicious Uses of AI, divulgado pela OpenAI essa semana. O documento detalha casos recentes de uso indevido de modelos generativos por atores associados a operações estrangeiras – incluindo contas vinculadas a atividades relacionadas à China – para apoiar campanhas de influência, produção de conteúdo enganoso e ações cibernéticas coordenadas.

O alerta, porém, vai além da geopolítica. A questão prática é outra: como o uso malicioso da IA impacta empresas, profissionais e consumidores no dia a dia?

A CM Responde.

A IA criou novos ataques?

Não exatamente. O que mudou foi a escala – e a sofisticação. Segundo o relatório da OpenAI, ferramentas generativas vêm sendo utilizadas como suporte operacional em campanhas de desinformação, automação de interações falsas e produção de conteúdos estrategicamente adaptados.

Em outras palavras, a Inteligência Artificial funciona como aceleradora de processos que já existiam no ecossistema ofensivo. “A IA está reduzindo o esforço necessário para estruturar ataques convincentes e personalizados. O que antes demandava mais tempo e especialização técnica pode ser executado com maior velocidade e escala”, afirma César Baracat, CRO da Vultus, consultoria brasileira de cibersegurança.

Ele reforça que a IA não atua isoladamente.

“A IA funciona como multiplicador de capacidade dentro de um ecossistema ofensivo mais amplo. Ela se integra a redes sociais, sites falsos, engenharia social e exploração de vulnerabilidades conhecidas, aumentando eficiência e volume.”

O resultado é um processo de industrialização dos ataques digitais – com menor barreira de entrada, maior automação e testes contínuos até que o golpe funcione.

Para o consumidor, isso significa mensagens bem escritas, contextualmente coerentes e cada vez mais difíceis de identificar como fraude.

Por que os riscos digitais aumentam com IA?

Porque a combinação entre automação e personalização muda o jogo.

Com Inteligência Artificial, ataques se tornam:

- Mais personalizados, com linguagem adaptada ao perfil da vítima;

- Mais rápidos, com testes e variações em escala;

- Mais convincentes, com textos, imagens e até vozes sintéticas difíceis de identificar.

Na prática, isso aumenta a taxa de sucesso de fraudes digitais – e amplia a exposição tanto de grandes organizações quanto de consumidores comuns.

Empresas: alvo e vetor de exposição

O impacto corporativo ocorre em duas frentes – e, em ambas, o consumidor está envolvido. Em primeiro lugar, a empresa como alvo direto. Ou seja, campanhas de spear phishing direcionadas a executivos, exploração automatizada de vulnerabilidades e criação de páginas falsas sofisticadas estão entre os principais riscos.

“Isso pressiona as organizações a irem além de uma postura reativa. A prioridade passa a ser a redução contínua da exposição e a atuação direta sobre os vetores que efetivamente aumentam a probabilidade de comprometimento”, destaca Baracat.

Quando uma empresa é comprometida, o impacto não se restringe à marca. Dados de clientes, informações financeiras e registros sensíveis entram na equação. O risco corporativo rapidamente se transforma em risco ao consumidor.

A empresa como vetor involuntário de vazamento

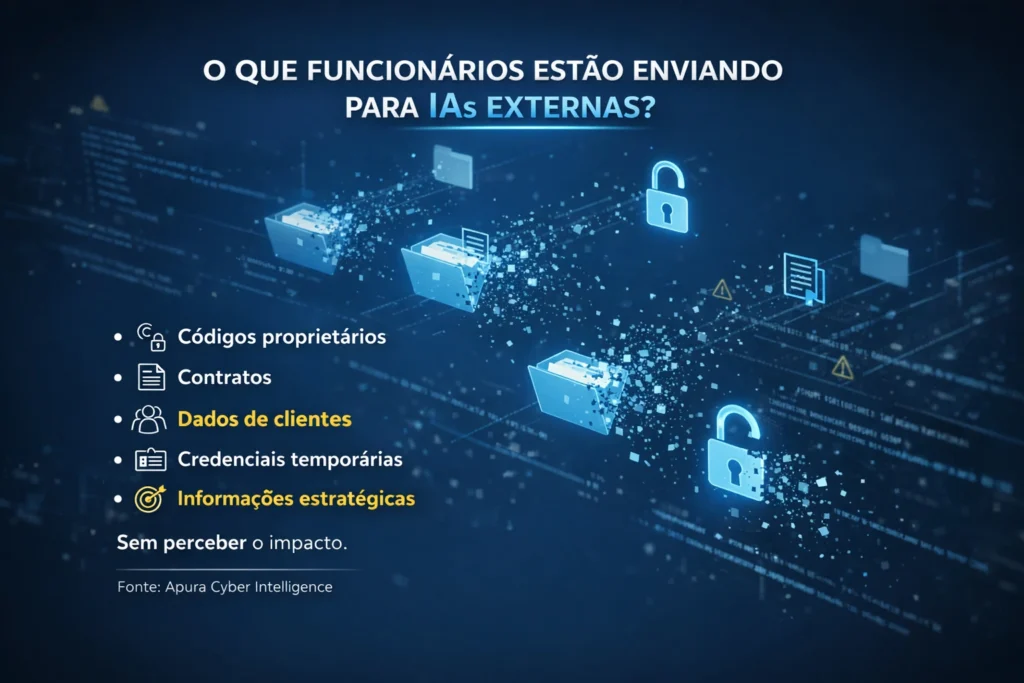

Existe ainda um risco silencioso: o uso desordenado de ferramentas de IA por colaboradores – fenômeno conhecido como Shadow AI.

Levantamento da Apura Cyber Intelligence mostra que funcionários frequentemente inserem em plataformas externas:

- Códigos proprietários;

- Contratos;

- Dados de clientes;

- Credenciais temporárias;

- Informações estratégicas.

Muitas vezes, sem perceber o impacto.

“As pessoas geralmente não percebem que, ao enviar informações para um LLM, estão expondo dados a um ambiente que não diferencia conteúdo sensível de conteúdo comum. Muitos usuários copiam códigos, contratos, registros internos ou dados pessoais acreditando estar num espaço privado”, alerta Pollyne Zunino, Subcoordenadora do SWAT Team na Apura e especialista em Investigação de Crimes Cibernéticos.

Ela traz um ponto crucial: o problema não está apenas na resposta gerada pela IA – mas no envio da informação. “O modelo apenas processa o que recebe, e os provedores podem manter esses dados para aprendizagem da IA, além de registros técnicos para auditoria e segurança.”

Em outras palavras: o dado que sai do controle do usuário pode não voltar mais ao seu controle.

O consumidor também está exposto?

Sim – tanto como alvo quanto como fonte de dados.

Golpes digitais ganham qualidade textual, coerência contextual e aparência profissional. Isso reduz sinais clássicos de fraude e aumenta o poder de convencimento.

Mas há uma segunda camada de risco: a exposição voluntária.

“A IA não é seu diário. Não é sua caixa de e-mail confidencial. Antes de colar qualquer conteúdo, a pergunta deve ser: ‘Se isso vazasse, eu ficaria tranquilo?’”, afirma Pollyne Zunino.

A especialista destaca ainda que grupos criminosos exploram técnicas como prompt injection, model inversion e membership inference para extrair padrões sensíveis ou manipular o comportamento de modelos.

“Em outras palavras, o criminoso não precisa mais invadir a rede. Ele só precisa acessar o que vazou pelos prompts de IA.”

Isso significa que, em muitos casos, a porta de entrada não é uma invasão sofisticada, mas um simples copiar e colar.

O risco é só tecnológico? Não

Existe também uma dimensão cultural e informacional.

O pesquisador de cultura analítica Ricardo Cappra chama atenção para o que define como o “iceberg da informação”.

“Dados não falam sozinhos. Eles são escolhidos, tratados e interpretados. Cada gráfico carrega decisões anteriores, interesses explícitos ou implícitos e vieses que raramente aparecem na superfície da informação.”

Segundo ele, o avanço da IA aprofunda essa assimetria. “Ferramentas capazes de gerar análises e narrativas sofisticadas proporcionam um resultado ainda mais convincente, enquanto o processo que o sustenta se torna menos auditável.”

Para o consumidor, isso representa um desafio adicional: quanto mais convincente a narrativa automatizada, menor tende a ser o questionamento sobre sua construção.

A pergunta deixa de ser apenas “isso é verdadeiro?” e passa a ser “como isso foi produzido?”.

Quem controla o controlador?

A discussão também envolve poder algorítmico e concentração de dados.

Para o escritor e entusiasta de tecnologia Rick Schwartz, o debate atual não gira em torno de máquinas conscientes, mas de sistemas automatizados influenciando decisões humanas em escala global.

“Não estamos navegando em um espaço neutro. Estamos atravessando um filtro algorítmico que prioriza conteúdos com maior probabilidade de manter nossa atenção”, pontua Rick, escritor e autor do livro Future Rising: A Sétima Máquina.

Ele alerta para a concentração de dados nas chamadas big techs e levanta uma provocação central:

“A pergunta não é se a IA controla. A pergunta é: quem controla a IA? E, sobretudo, quem controla os controladores? Afinal, a humanidade está caminhando para uma geração em que a tomada de decisões é feita por algoritmos?”

Para o consumidor, isso se traduz em um cenário em que preferências, inclinações políticas, fragilidades emocionais e padrões de consumo podem ser continuamente modelados por sistemas invisíveis.

E o Direito? A lei acompanha esse cenário?

O ambiente digital também exige uma nova lente jurídica.

A advogada Ana Rios, especialista em Direito Cibernético, lembra que o mundo online redefine conceitos clássicos de território, responsabilidade e jurisdição.

“O Direito Cibernético questiona como atuar numa arena em que território, agente criminoso e vítima muitas vezes são fluídos.”

Ana, sócia e diretora Jurídica da IPV7 Group, destaca que a Lei Geral de Proteção de Dados (LGPD) impõe obrigações claras sobre tratamento de informações pessoais – mas reconhece que a tecnologia evolui mais rápido do que a legislação.

“A penalização deixa de ser apenas uma hipótese teórica: em um mundo conectado, o processo judicial pode atingir milhares de pessoas ao mesmo tempo.”

Outro grande desafio é a atuação em âmbito global. Ou seja, um único dado pode trafegar por diferentes países em segundos; a plataforma pode estar registrada em uma jurisdição, o servidor hospedado em outra e o desenvolvedor localizado em um terceiro país. “Essa fragmentação torna a definição de competência jurídica mais complexa e impõe a necessidade de cooperação internacional entre autoridades.”

Nesse ínterim, para Ana Rios, à medida que o ambiente digital se consolida como infraestrutura essencial da vida econômica e social, também se tornam mais evidentes as responsabilidades de provedores, plataformas e desenvolvedores – além da importância de uma arquitetura de rede desenhada com critérios de segurança, transparência e governança desde a origem.

Para empresas, isso significa governança e transparência. Para consumidores, significa o direito de exigir clareza, proteção e responsabilização.

Como empresas e consumidores podem se proteger?

Especialistas recomendam:

- Não inserir dados sensíveis em ferramentas não homologadas;

- Seguir políticas internas de segurança;

- Priorizar soluções corporativas com governança clara;

- Avaliar uso de modelos locais quando houver dados estratégicos;

- Reforçar treinamentos sobre engenharia social;

- Manter monitoramento contínuo de exposição digital.

LLMs hospedados localmente, por exemplo, podem reduzir o envio de dados a terceiros e facilitar conformidade com legislações como LGPD e GDPR.

Mas há um ponto transversal: consciência crítica.

Em um ambiente em que ataques são automatizados, dados são invisivelmente processados e narrativas são geradas sob demanda, a proteção não é apenas tecnológica – é também comportamental.

O que muda daqui para frente?

O relatório da OpenAI reforça que a IA já integra operações maliciosas reais. Não como protagonista isolada, mas como parte de uma engrenagem mais eficiente.

A defesa, portanto, deixa de ser exclusivamente técnica. Exige governança, cultura organizacional, responsabilidade jurídica e comportamento consciente do usuário.

A IA está aprendendo o tempo todo.

A pergunta central – para empresas e consumidores – é outra: estamos aprendendo na mesma velocidade?