A Inteligência Artificial (IA) deixou de ser promessa futurista para se tornar parte invisível – e decisiva – da rotina de consumo. Ela recomenda produtos, organiza finanças, responde atendimentos em segundos e influencia escolhas antes mesmo de o consumidor perceber. Ao mesmo tempo em que amplia conveniência e personalização, também eleva o nível de exposição a golpes digitais, deepfakes e uso indevido de dados pessoais.

Em um cenário em que quase 90% dos brasileiros já acreditaram em fake news e em que ferramentas de geração de imagem, vídeo e voz tornam fraudes cada vez mais realistas, a confiança digital passa a ser um dos ativos mais frágeis da economia contemporânea. A tecnologia que empodera também vulnerabiliza – e exige novos protocolos de proteção.

Para entender como a IA está redesenhando a jornada de consumo, quais são os principais riscos emergentes e que tipo de regulação e comportamento podem equilibrar inovação e segurança, a Consumidor Moderno conversou com Kenneth Corrêa, estrategista em Tecnologias Emergentes e Inteligência Artificial, professor C-level da Fundação Getulio Vargas e autor do livro Organizações Cognitivas – Alavancando o Poder da IA Generativa e dos Agentes Inteligentes, lançado pelo MIT (Massachusetts Institute of Technology).

Segundo ele, a tecnologia que empodera também vulnerabiliza – e, portanto, exige novos protocolos de proteção. Kenneth Corrêa alerta que, além do consumidor, os próprios líderes ainda não estão plenamente preparados para lidar com esse novo nível de complexidade. Muitas organizações adotam IA sem uma estratégia clara de governança, segurança e capacitação, o que amplia riscos reputacionais, jurídicos e financeiros.

Acompanhe!

IA: conveniência de um lado; manipulação de outro

Consumidor Moderno: Quais são hoje os principais benefícios da IA para o consumidor – e onde estão os maiores riscos?

Kenneth Corrêa: Excelente ponto de partida. Em 2026, já superamos a fase de adoção inicial da Inteligência Artificial. Agora, vivemos a massificação. Segundo dados recentes do Datafolha, cerca de 93% dos brasileiros utilizam algum recurso de IA no dia a dia – muitas vezes sem perceber.

O principal benefício é a hiperpersonalização aliada à conveniência. A IA funciona como um verdadeiro “copiloto” do consumo. Ela compara ofertas complexas, planeja viagens e organiza finanças com rapidez e precisão. No varejo, empresas estão utilizando redes de agentes inteligentes não apenas para recomendar produtos, mas para antecipar necessidades e resolver problemas de atendimento em segundos.

Por outro lado, os riscos crescem na mesma proporção. Para oferecer hiperpersonalização, empresas coletam um volume gigantesco de dados sensíveis. Isso amplia a exposição a vazamentos e ao uso indevido de informações.

Ao mesmo tempo, ferramentas como Midjourney, Veo 3 e ElevenLabs reduziram drasticamente o custo para criar golpes sofisticados. Como resultado, deepfakes e campanhas de phishing altamente personalizadas se tornaram comuns. Eis o paradoxo: a mesma tecnologia que empodera o consumidor também torna o ambiente digital mais hostil.

Mais dados, mais exposição

CM: Se a internet se tornou uma necessidade básica, como empresas e governos deveriam encarar a proteção do consumidor digital?

A internet deixou de ser conveniência. Hoje, ela é infraestrutura crítica – assim como água e energia elétrica.

Quando alguém tem o WhatsApp clonado, perde acesso à conta bancária ou sofre invasão no perfil comercial, enfrenta prejuízo financeiro imediato e impacto emocional relevante. Portanto, governos precisam tratar proteção digital como segurança pública essencial. Isso exige estruturas mais ágeis e uso de IA para combater crimes cibernéticos automatizados.

Identidades digitais, como o Gov.br, devem incorporar camadas biométricas e comportamentais preditivas. Já as empresas precisam colocar a segurança no centro da jornada do cliente. Não basta usar IA para vender mais. É preciso usá-la para proteger quem compra.

Bancos como Nubank e Itaú Unibanco já utilizam modelos preditivos que bloqueiam transações fraudulentas em tempo real. Em uma organização cognitiva, agentes autônomos monitoram ameaças invisíveis e protegem o consumidor nos bastidores.

Da era do “ver para crer” ao “duvidar por padrão”

CM: Como deepfakes e conteúdos sintéticos impactam a confiança do consumidor?

Estamos migrando da era do “ver para crer” para o “duvidar por padrão”. Com ferramentas capazes de gerar vídeos ultrarrealistas e clonar vozes a partir de poucos segundos de amostra, não é mais possível confiar cegamente em um áudio ou vídeo.

A autenticidade tornou-se o ativo mais valioso das marcas. Empresas começam a adotar certificações de origem, como protocolos C2PA, ou marcas d’água invisíveis, como o SynthID, para comprovar autenticidade. Ainda assim, o volume de conteúdo sintético supera a capacidade de moderação.

Na prática, a confiança passa a ser construída na previsibilidade e na clareza dos canais oficiais. Marcas que educam seus clientes sobre como – e como não – se comunicam terão vantagem competitiva.

CM: Quais sinais indicam que o consumidor está interagindo com IA ou conteúdo manipulado?

O primeiro sinal é a perfeição excessiva sem contexto. Respostas instantâneas, gramática impecável e incapacidade de sair de um roteiro indicam automação.

Além disso, golpistas criam senso extremo de urgência para forçar decisões rápidas, como pedidos de Pix imediato.

Em conteúdos visuais, observe:

- Piscar mecânico;

- Sombras inconsistentes;

- Distorções em contornos.

Em áudios clonados, pode faltar cadência respiratória natural ou expressões íntimas características. O alerta máximo deve acender quando alguém exige transferência financeira com base apenas em emoção.

Entre inovação e responsabilidade

CM: Líderes e profissionais estão preparados para os dilemas éticos da IA?

A resposta honesta é: não. Mesmo líderes experientes continuam vulneráveis. Ainda cometeremos erros antes de alcançar maturidade ética suficiente.

O maior desafio é manter senso crítico constante. A persuasão algorítmica não respeita cargo nem experiência.

Em momentos de cansaço ou distração, qualquer pessoa pode cair em um golpe altamente personalizado.

CM: Que tipo de regulação é essencial para equilibrar inovação e proteção?

A regulação deve focar na aplicação da tecnologia, não na tecnologia em si. Um crime continua sendo crime, mesmo quando alguém usa IA para cometê-lo.

O Tribunal Superior Eleitoral (TSE) deu um exemplo relevante nas eleições municipais de 2024. O órgão proibiu robôs para contato ativo com eleitores e vetou deepfakes contra adversários, com punição clara: inelegibilidade.

Portanto, o segredo está na sanção efetiva. Regras claras, fiscalização adequada e consequências severas protegem o consumidor sem sufocar a inovação.

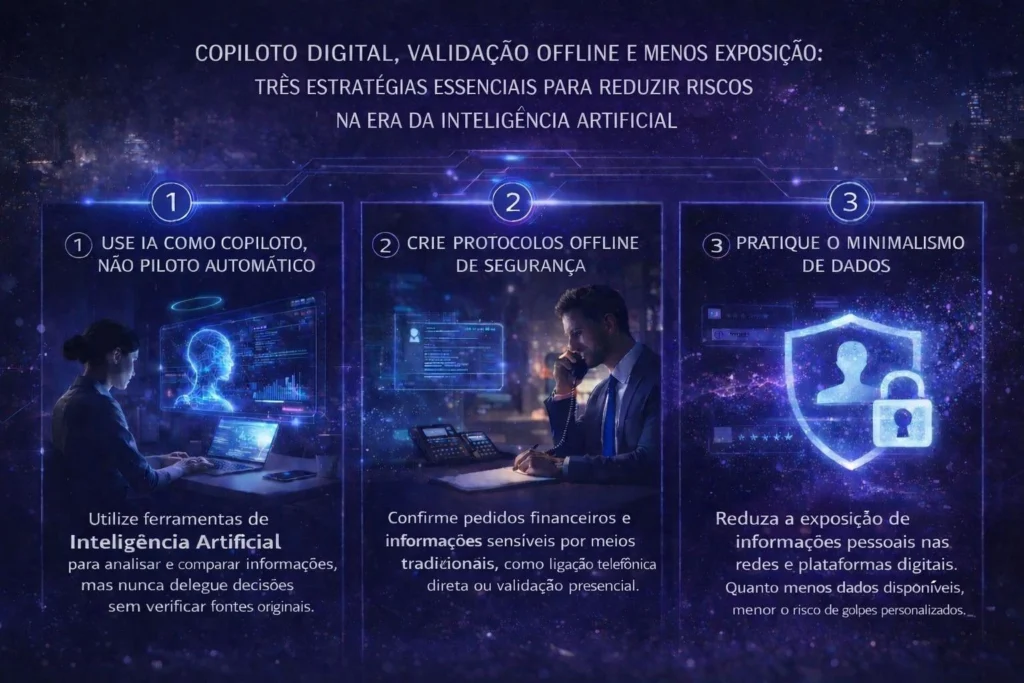

Estratégias para reduzir risco

CM: Quais três atitudes práticas o consumidor deve adotar agora?

Em primeiro lugar, use IA como copiloto, não piloto automático. Em outras palavras, o usuário deve utilizar ferramentas para resumir, comparar e analisar informações. No entanto, nunca delegar decisões sensíveis sem checar fontes originais.

Por consequência, a recomendação é criar protocolos analógicos para ameaças digitais. Ou seja, a ideia é estabelecer palavras de segurança familiares para confirmar pedidos financeiros. Além disso, valide transferências urgentes por ligação tradicional.

E, por fim, mas não menos importante, adote o minimalismo de dados. O consumidor deve reduzir a exposição de rotinas, áudios longos e informações pessoais em perfis públicos. Quanto menos dados disponíveis, mais difícil se torna criar golpes personalizados.