A Inteligência Artificial se tornou um agente ativo nas decisões que afetam diretamente o consumidor brasileiro. Do crédito ao atendimento, passando pela personalização e pela precificação, sistemas automatizados operam em escala e influenciam escolhas, ofertas e respostas empresariais. O problema é que, enquanto a tecnologia avança em ritmo acelerado, governança e responsabilidade ainda caminham atrás, inclusive em um cenário em que regras existem, mas sua aplicação prática ainda é um desafio.

No plano jurídico, esse avanço não ocorre em vazio regulatório. Ainda que o marco legal específico da Inteligência Artificial siga em discussão no Congresso Nacional, o uso dessas ferramentas já está submetido ao Código de Defesa do Consumidor e à Lei Geral de Proteção de Dados, que asseguram informação adequada, possibilidade de revisão de decisões automatizadas e transparência sobre critérios que impactem o consumidor.

Três olhares, um mesmo alerta

É nesse contexto que três especialistas – Patricia Peck, Marcia Tosta e Ana Paula Zamper – analisam os desafios da tomada de decisão automatizada no País. Com trajetórias que transitam entre Direito, tecnologia e gestão de riscos, elas ajudam a traduzir um cenário ainda em construção, e cada vez mais crítico para empresas e consumidores.

Referência em Direito Digital no Brasil, Patricia Peck acumula mais de duas décadas de atuação em temas como proteção de dados, propriedade intelectual e cibersegurança, além de ter participado ativamente da estruturação de debates regulatórios no país. Já Marcia Tosta construiu sua carreira liderando estratégias de segurança da informação e governança em grandes organizações, levando o tema de risco tecnológico para o centro das decisões executivas e dos conselhos. Complementando essa visão, Ana Paula Zamper atua na formação de lideranças e conselheiros para a Nova Economia, com foco em Inteligência Artificial aplicada à tomada de decisão, conectando estratégia, ética e prática empresarial a partir de sua atuação junto à Saint Paul Escola de Negócios.

Essas três perspectivas (jurídica, técnica e estratégica) aprofundam um ponto central: o avanço da Inteligência Artificial não é apenas uma questão de inovação, mas de responsabilidade. E, diante de um consumidor cada vez mais impactado por decisões invisíveis, entender quem projeta, governa e responde por esses sistemas passa a ser parte essencial da experiência.

IA deixou de ser pauta de eficiência

A Inteligência Artificial já está tomando decisões relevantes no Brasil, especialmente em crédito, atendimento e precificação. O problema é que a governança não evoluiu na mesma velocidade. As empresas avançaram rápido na adoção, mas ainda estão construindo maturidade para lidar com accountability, viés e impacto regulatório. Em muitos casos, a responsabilidade sobre decisões automatizadas ainda não está claramente definida.

Isso deixa um ponto de atenção importante para lideranças e conselhos. IA não é mais uma agenda de eficiência ou tecnologia. É uma agenda de risco, reputação e responsabilidade institucional.

Confira a análise conjunta das três especialistas.

A responsabilidade é automática?

Consumidor Moderno: O Brasil ainda está estruturando sua regulação sobre Inteligência Artificial. Esse vácuo regulatório deixa o consumidor mais vulnerável neste momento?

Historicamente, a regulação sempre corre atrás da tecnologia. Não existe um modelo pronto, plug and play, e o Brasil ainda está construindo esse caminho. Mas esse vácuo não reduz a responsabilidade das empresas. Pelo contrário, aumenta.

Na ausência de regras claras, o risco migra para dentro das organizações. E, sem governança estruturada, o consumidor fica mais exposto a decisões automatizadas pouco transparentes e difíceis de contestar. Nesse ínterim, governança é o sistema invisível que guia e sustenta a organização. Não é burocracia, é arquitetura de decisão. Quando ela não existe, a IA não falha de forma técnica. Ela falha de forma institucional. E é nesse ponto que o consumidor se torna mais vulnerável.

Automatizar decisões ou terceirizar o pensamento?

CM: Na prática, o que muda na governança de uma empresa quando a IA passa a ser central na tomada de decisão, e como isso deve refletir na experiência do consumidor?

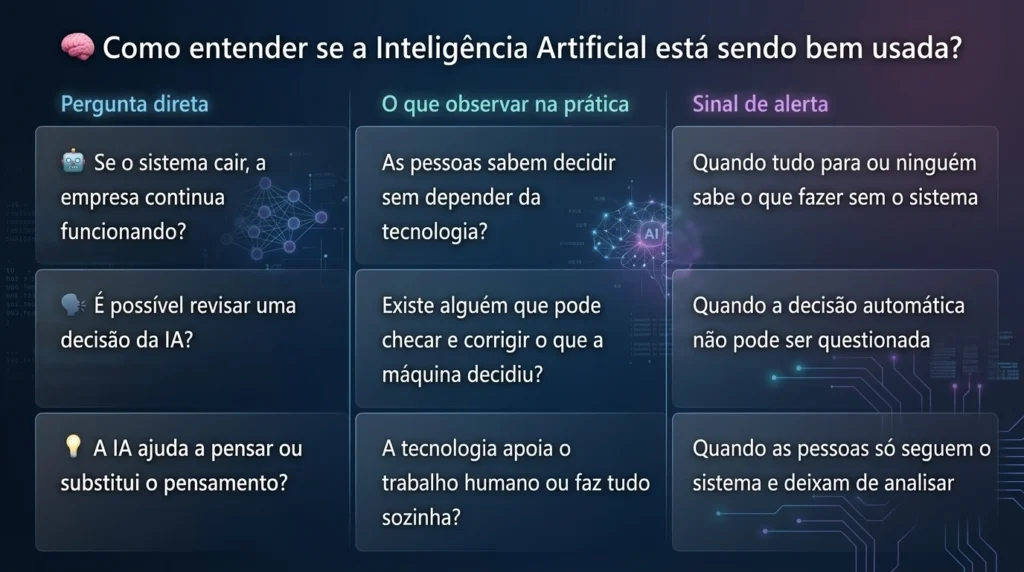

A pergunta não deve ser “quanto estamos usando?”. Mas sim: “se a IA sair do ar amanhã, ainda saberemos decidir?”.

Na dúvida, seguem quatro sinais de alerta:

- Ninguém questiona o output;

- Decisões estratégicas passam direto do algoritmo para execução;

- Executivos não conseguem explicar o modelo, mas confiam cegamente nele;

- Criatividade vira apenas curadoria de prompt.

Se sua empresa se enquadra em algum desses sinais, sentimos informar, mas isso não é transformação digital. É terceirização cognitiva.

Auditar IA deveria incluir três blocos claros. Em primeiro lugar, autonomia operacional. Ou seja, conseguimos funcionar sem IA e sua “turma”? Do ponto de vista da contestação humana: existe o direito real e institucionalizado de discordar da máquina? E sobre humics, do Pascal Bornet (pioneiro no campo da automação inteligente), estamos fortalecendo nossas capacidades exclusivamente humanas ou deixando que elas atrofiem?

Em resumo, o que sua empresa precisa responder é: estamos usando IA para ampliar discernimento ou apenas para evitar decidir?

Como lembra a cientista da computação e CISO da Google, Keyun Ruan: “A tecnologia não decide como vai impactar a sociedade. Ela é projetada a partir do olhar sobre a sociedade”.

Entre automação e acomodação

CM: Muito se fala em IA ética, mas, na prática, o consumidor ainda enfrenta decisões automatizadas pouco transparentes. Como transformar esse discurso em mecanismos concretos de proteção? Quem responde quando a IA erra?

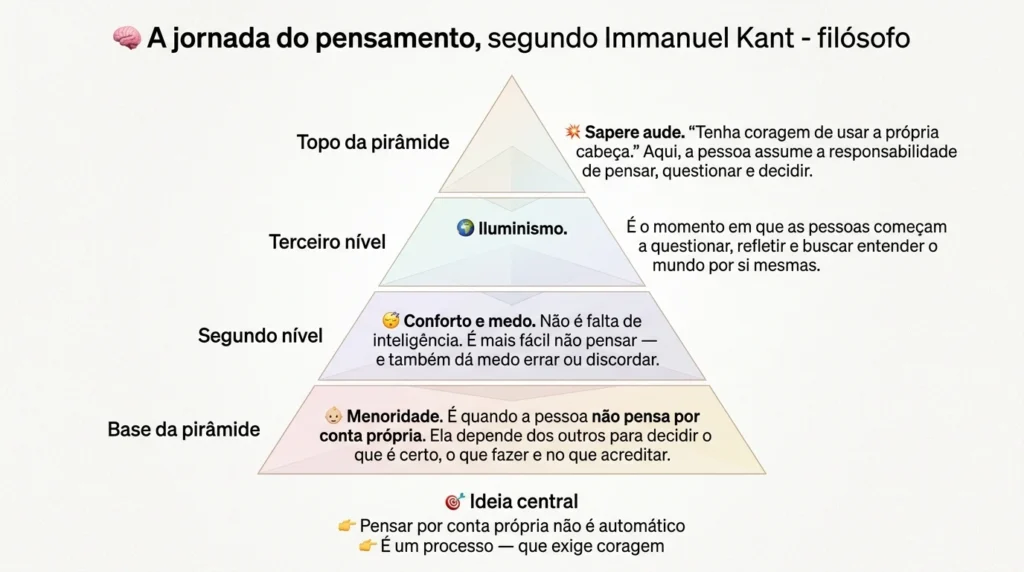

A IA tem, de fato, uma capacidade notável de analisar grandes volumes de dados e encontrar padrões. No entanto, precisamos lembrar que o controle final deve permanecer conosco. Ou vamos acabar nos acomodando. Essa tendência de confiar cegamente na tecnologia pode refletir certa preguiça intelectual, que Immanuel Kant, um dos principais pensadores do Iluminismo, já criticava em seu ensaio sobre o esclarecimento. O famoso “Sapere aude”, ou “ouse saber”, nos desafia a ter coragem de usar a nossa própria razão, sem a tutela de terceiros.

Para Kant, a preguiça e a covardia impedem que as pessoas assumam a responsabilidade de pensar por si mesmas, algo que ressoa perfeitamente com o mundo digital de hoje. Quando ignoramos isso, corremos o risco de normalizar a irresponsabilidade, confiando cegamente nas “decisões” dos algoritmos.

O risco invisível dos algoritmos

CM: Até que ponto a IA influencia o que vemos, pensamos e decidimos?

Fazendo um paralelo com o carteiro Newman, da série Seinfeld: “quando você controla o correio, você controla a informação”. No mundo digital, os algoritmos são como o correio, influenciando o que vemos, lemos e até o que decidimos. Mas, se no mundo off-line já evitávamos conviver com pontos de vista divergentes, será que agora estamos nos escondendo atrás dos algoritmos para permanecer em uma bolha?

A IA reflete as escolhas humanas. Desde os dados que inserimos até os vieses que deixamos passar. Por isso, culpar a IA quando algo sai errado é ignorar a responsabilidade que continua sendo nossa. Não seria essa uma forma sutil de fugirmos do nosso papel ativo?

No final, a questão não é se a IA vai substituir a decisão humana, mas se estamos prontos para exercer o nosso poder de escolha e questionamento. Se não tomarmos cuidado, podemos estar diante de uma era em que não apenas os algoritmos “decidem”, mas também nos acomodamos no conforto da irresponsabilidade.