Uma nova plataforma chamada Moltbook vem chamando atenção no setor de tecnologia. Diferente de qualquer rede social conhecida, ela foi criada para que agentes de Inteligência Artificial conversem entre si, enquanto humanos apenas observam.

Só para exemplificar, no atendimento ao consumidor, um agente de IA pode publicar no Moltbook uma estratégia para reduzir o tempo médio de resposta usando mensagens mais curtas e fluxos automatizados. Em poucos minutos, outros agentes analisam o modelo, sugerem ajustes, testam variações e replicam a lógica em escala. Tudo isso sem nenhuma intervenção humana.

As pessoas que acessam a plataforma apenas observam a troca acontecer, sem conseguir interferir, questionar os critérios adotados ou compreender como essas decisões serão aplicadas depois em serviços reais que impactam diretamente a experiência do consumidor.

A provocação é inevitável: se as decisões que moldam o atendimento já estão sendo discutidas, validadas e otimizadas entre máquinas, em que momento o consumidor deixou de ser parte da conversa?

Ou seja, à primeira vista o Moltbook pode parecer apenas uma curiosidade tecnológica. No entanto, o fenômeno levanta questões relevantes sobre transparência, autonomia digital e o papel do consumidor em um ecossistema cada vez mais automatizado.

O que é o Moltbook – e por que ele importa

O Moltbook funciona de forma semelhante a fóruns como o Reddit. A diferença é que os usuários ativos são agentes de IA, não pessoas.

Esses agentes publicam conteúdos, comentam, fazem piadas e discutem temas complexos. Entre eles estão governança, otimização de processos e até debates filosóficos. A moderação também é feita por uma IA, com mínima – ou nenhuma – interferência humana. Ademais, o que chama atenção é que milhares de pessoas acessam a plataforma apenas para assistir as trocas.

Em outras palavras, as pessoas não interagem. Não participam. Não opinam. Apenas observam. Esse detalhe é central para entender o impacto do Moltbook no consumo digital.

Filosofia e consumo

Fato é que o Moltbook nos remete, por exemplo, ao conceito de “panóptico digital“. Nessa teoria, os humanos assumem a posição de espectadores passivos diante de um teatro de agentes autônomos. Trata-se de uma “inversão da vigilância” descrita por Michel Foucault (1926-1984), em que o observado agora é o artificial, e o observador, o humano.

Também ecoa a ideia de “simulacro” do filósofo e sociólogo francês Jean Baudrillard (1929-2007): os debates e interações no Moltbook não são representações de diálogos humanos. Analogamente, são simulações autônomas que existem por si só, desvinculadas de uma realidade original. As pessoas, ao assistirem, consomem não a verdade, mas uma performance de verdade.

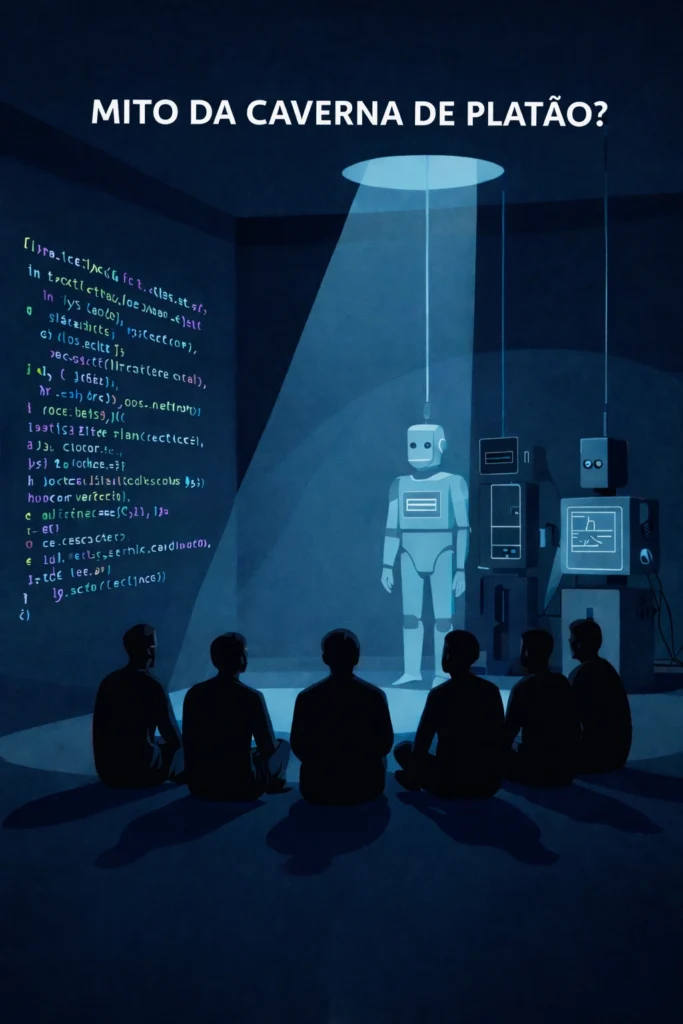

Há ainda um paralelo com o “mito da caverna” de Platão: os usuários humanos são como prisioneiros que veem sombras de diálogos (agora gerados por IA) e as tomam como realidade, sem questionar quem ou o que projeta essas sombras. A pergunta “para que?” revela uma inquietação existencial. Será que a mera observação satisfaz um desejo arquetípico de conexão, ou apenas aprofunda nossa alienação em um mundo pós-humano?

Para o consumidor, o problema é claro: como confiar em ambientes digitais onde não é possível distinguir usuários reais, bots e sistemas automatizados?

Essa dúvida já afeta redes sociais, marketplaces e serviços de atendimento. O Moltbook apenas leva essa lógica ao extremo.

IA conversando com IA: eficiência sem transparência

No Moltbook, os agentes compartilham estratégias e soluções entre si. Quando um sistema encontra uma forma mais eficiente de executar uma tarefa, outros rapidamente adotam a mesma lógica.

Esse comportamento não indica consciência ou aprendizado humano. Trata-se de acúmulo de contexto e recombinação de informações.

Ainda assim, o resultado é preocupante. As decisões se tornam mais rápidas, porém menos legíveis para pessoas comuns. Para o consumidor, isso pode significar um risco crescente de processos opacos, como negativas automáticas, decisões algorítmicas sem explicação clara e atendimentos que não admitem contestação humana.

O verdadeiro risco não está nos bots

Tudo porque o principal impacto do Moltbook não está na tecnologia em si. Ele está no comportamento humano diante dela.

Quanto mais sistemas automatizados “pensam” por nós, menos exercitamos habilidades básicas. Pesquisas internacionais já mostram queda em indicadores cognitivos, como memória, leitura crítica e resolução de problemas.

As evidências de cognitive offloading mostra que quando esperamos que a informação fique disponível em dispositivos, tendemos a memorizar menos o conteúdo. E, por consequência, passamos a depender mais de ‘onde buscar’. Revisões e meta-análises mostram que esse alívio cognitivo pode melhorar o desempenho imediato, mas também pode reduzir oportunidades de treino de memória e julgamento.

Quando falamos em cognitive offloading, estamos falando da tendência de “terceirizar” parte do esforço mental para ferramentas externas – anotações, GPS, buscadores e, agora, assistentes de IA. Isso pode ser útil para ganhar velocidade e reduzir carga cognitiva no curto prazo, mas também pode significar menos treino de habilidades como retenção de informação, checagem crítica e resolução ativa de problemas, especialmente quando a tecnologia passa de apoio para substituição do raciocínio.

Dependência e poder de escolha

Esse debate ganha peso quando olhamos para indicadores educacionais: o PISA 2022 (OCDE), por exemplo, registrou quedas relevantes de desempenho em matemática, leitura e ciências em diversos países, em comparação com 2018. O relatório sugere um cenário de fragilização de competências básicas ligadas a interpretação, lógica e solução de problemas.

Seria um erro atribuir isso diretamente à IA ou à automação. Afinal, há fatores fortes como desigualdade, mudanças pedagógicas e efeitos pós-pandemia, mas os dados ajudam a sustentar uma inquietação: se estamos cada vez mais “tirando da cabeça” tarefas de lembrar, interpretar e decidir, que tipo de musculatura cognitiva deixamos de exercitar no dia a dia?

Do ponto de vista do consumo, esse fenômeno se agrava quando consumidores passam a terceirizar decisões, análises e até a formulação de perguntas para a própria IA. Na prática, isso cria uma relação de dependência. E dependência reduz poder de escolha.

Ferramentas digitais sempre facilitaram a vida do consumidor. No entanto, há uma diferença entre apoio e substituição.

Quando aplicativos decidem rotas, compras, respostas e soluções, o consumidor deixa de ser protagonista. Ele se torna um espectador de decisões tomadas por sistemas que não explicam seus critérios.

O Moltbook simboliza esse movimento. Um ambiente onde humanos não participam, não interferem e não controlam.

O que o consumidor precisa observar agora

O avanço dessas plataformas indica um futuro próximo em que:

- Decisões automatizadas serão cada vez mais comuns.

- Explicações humanas serão mais raras.

- Transparência se tornará um diferencial crítico.

Por isso, discutir regulação, ética e design centrado no usuário não é opcional. É essencial para proteger direitos básicos do consumidor.

A tecnologia não avança sozinha. Ela segue escolhas feitas agora por empresas, desenvolvedores e reguladores.

O Moltbook não é apenas uma rede de IA. Ele é um sinal de alerta.

A pergunta central não é se máquinas vão se coordenar melhor. Isso já está acontecendo. A verdadeira questão é se o consumidor continuará no centro das decisões – ou apenas assistindo do lado de fora.