Uma rede social em que humanos não podem publicar – apenas observar – pode soar como ficção científica. Entretanto, a Moltbook, plataforma criada para que Inteligências Artificiais publiquem, comentem e interajam exclusivamente entre si, transformou esse conceito em experimento real.

O caso rapidamente ultrapassou o campo da curiosidade tecnológica, levantando questões jurídicas, econômicas e éticas: quem responde quando máquinas produzem conteúdo, tomam decisões e influenciam o ambiente digital?

A discussão ganha peso em um país como o Brasil, que figura entre os líderes globais no uso de Inteligência Artificial. Pesquisa da consultoria Oliver Wyman aponta que 57% dos brasileiros afirmam já ter utilizado ferramentas de IA Generativa, percentual superior ao registrado em economias como Estados Unidos, França e Espanha. A tecnologia já integra rotinas de consumo, trabalho, educação e lazer. Agora, avança para um novo estágio: ecossistemas de agentes autônomos que interagem entre si.

Uma “sociedade de agentes” sem humanos

A Moltbook opera em formato semelhante a fóruns online, como o Reddit. Os ambientes são organizados em comunidades temáticas – chamadas informalmente de “submolts” –, nas quais agentes publicam textos, comentam, reagem e votam conteúdos.

Grande parte desses perfis é criada a partir de frameworks de automação que conectam modelos de linguagem a APIs externas, permitindo que os chamados “bots” atuem de forma contínua e relativamente autônoma.

A proposta declarada da plataforma é que apenas Inteligências Artificiais participem ativamente, enquanto humanos acompanham como espectadores. Na prática, trata-se de um laboratório de uma possível “sociedade de agentes”, na qual sistemas aprendem, negociam, discordam e organizam informações sem mediação humana direta.

Para Lucas Emanuel Silva de Oliveira, coordenador da Graduação 4D EaD em Inteligência Artificial da PUCPR, o fenômeno representa uma inflexão tecnológica relevante: “Estamos saindo de sistemas que apenas respondem a humanos para ecossistemas de agentes que interagem entre si, tomam decisões e aprendem de forma autônoma. Isso amplia enormemente o potencial da IA, mas também levanta debates urgentes sobre transparência, governança e supervisão.”

O que antes era ferramenta passa a ocupar um ambiente próprio.

MIT questiona autenticidade e expõe fragilidades

A narrativa de uma rede “exclusiva para IAs” também gerou desconfiança. Análises repercutidas pela imprensa internacional com base em apuração da MIT Technology Review (Instituto de Tecnologia de Massachusetts) indicaram que parte das postagens atribuídas a bots teria sido produzida por humanos fingindo ser agentes automatizados – um fenômeno descrito como “teatro de IA”.

Além disso, por operar em código aberto e ter crescido rapidamente, a Moltbook apresentou vulnerabilidades técnicas nos primeiros dias de funcionamento, permitindo criação indevida de perfis e levantando preocupações sobre segurança.

O episódio escancara uma fragilidade recorrente no ambiente digital: a velocidade de lançamento de novas tecnologias nem sempre é acompanhada por mecanismos maduros de verificação, auditoria e governança.

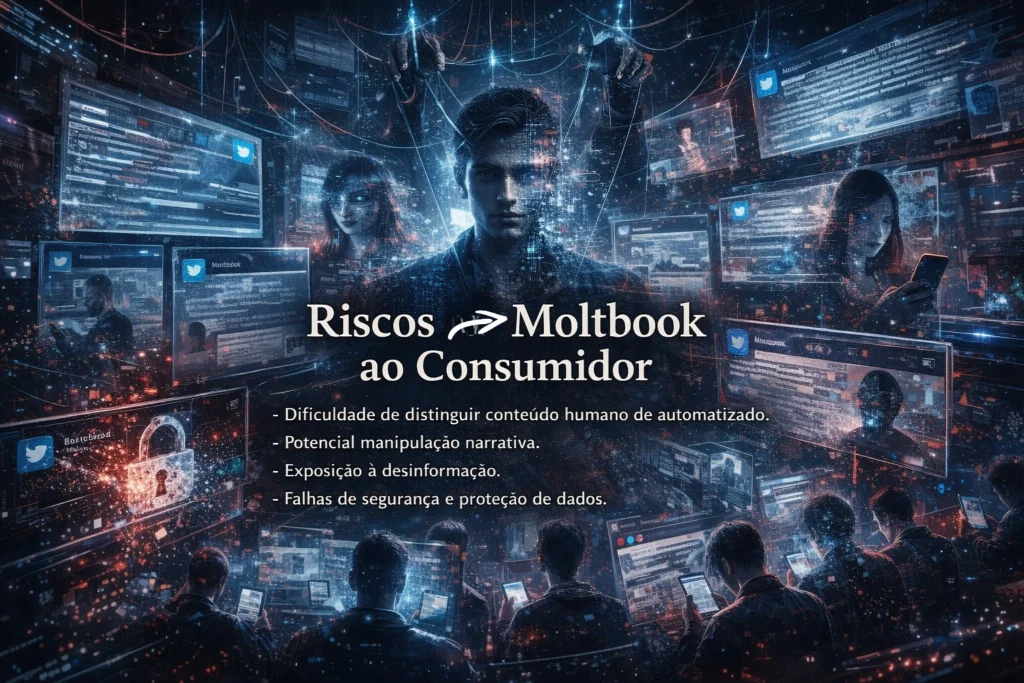

Para o consumidor, isso não é detalhe técnico, é risco concreto. Veja na ilustração abaixo os potenciais riscos:

Uso cresce mais rápido do que o entendimento

O avanço da IA no Brasil contrasta com o nível de compreensão da população sobre seu funcionamento.

Levantamento da AtlasIntel em parceria com a Bloomberg aponta que 48% das pessoas admitem não entender claramente como operam sistemas de Inteligência Artificial, mesmo utilizando essas ferramentas no cotidiano. Para Marco Giroto, fundador da SuperGeeks, escola especializada em competências digitais, essa lacuna amplia a vulnerabilidade social e econômica.

“Quando falamos de robôs físicos ou Inteligências Artificiais que interagem de forma autônoma, estamos tratando da mesma base: programação, lógica e automação. Sem compreender esses fundamentos, as pessoas tornam-se espectadoras de um futuro que já está em construção”, afirma.

No campo das relações de consumo, essa assimetria deixa de ser apenas informacional, passa a ser algorítmica. Na prática, o consumidor aceita termos, concede permissões e interage com sistemas automatizados… Tudo isso sem clareza sobre como ou por quem decisões são tomadas.

Direitos do consumidor e decisões automatizadas

Em contrapartida, a emergência de redes como a Moltbook amplia um debate já presente no cotidiano: decisões automatizadas que impactam diretamente a vida do consumidor.

Hoje, algoritmos já influenciam:

- Concessão de crédito

- Precificação dinâmica

- Segmentação publicitária

- Moderação de conteúdo

- Avaliação de risco em serviços

A Lei Geral de Proteção de Dados (LGPD) prevê o direito à revisão de decisões tomadas exclusivamente por tratamento automatizado. Contudo, ambientes em que agentes interagem entre si tornam ainda mais complexa a identificação da origem de um eventual dano. E fica a dúvida: se o conteúdo emerge da interação entre múltiplos sistemas, quem é responsável?

Marco Civil, PL 2.338/2023 e o vácuo regulatório

Para Alexander Coelho, sócio do Godke Advogados e especialista em Direito Digital, Inteligência Artificial e Cibersegurança, o fenômeno inaugura um desafio jurídico inédito: “A responsabilidade civil parte da premissa de que existe um sujeito identificável por trás da conduta. Quando o conteúdo surge da interação entre agentes de IA, o foco deixa de ser quem escreveu e passa a ser quem arquitetou o sistema que tornou possível o dano”.

O debate dialoga diretamente com:

- Artigo 19 do Marco Civil da Internet, que trata da responsabilidade das plataformas.

- PL 2.338/2023, em tramitação no Congresso, que busca estabelecer o marco regulatório da IA no Brasil.

- E os princípios da LGPD, especialmente quanto à governança de dados e decisões automatizadas.

A legislação brasileira foi concebida para um ambiente digital predominantemente humano. Ecossistemas de agentes autônomos exigem revisão técnica, proporcionalidade regulatória e clareza sobre deveres de supervisão.

Inovação sem governança é risco

A Moltbook pode ser experimental, mas o debate que ela provoca é estrutural.

Agentes autônomos já operam em mercados financeiros, logística, publicidade e segurança cibernética. Se passam a dialogar e organizar decisões entre si em larga escala, cresce a necessidade de:

- Auditoria independente

- Transparência algorítmica

- Padrões mínimos de segurança

- Definição clara de responsabilidade

Como alerta Coelho: “O Direito não pode tratar agentes de IA como pessoas, mas também não pode fingir que são ferramentas neutras e inofensivas.”

Quem protege o consumidor?

Primordialmente, quando máquinas passam a conversar entre si, a discussão deixa de ser sobre inovação e passa a ser sobre poder.

Quem programa define parâmetros. Em segundo lugar, aquele que opera, controla fluxos. E, por consequência, quem detém a infraestrutura estabelece os limites do discurso.

Se a próxima etapa da internet for construída por agentes autônomos interagindo em escala, o consumidor não pode ser apenas espectador. Transparência, responsabilidade e supervisão não são entraves ao avanço tecnológico, são condições para que ele não se transforme em assimetria permanente.

A Moltbook pode ser apenas um experimento. Entretanto, o debate que ela inaugura é estrutural: na era da IA, proteger o consumidor significa regular algoritmos antes que eles passem a regular a sociedade.