A petição parecia impecável. Linguagem técnica, argumentos bem estruturados, referências jurídicas sólidas. Ao menos até o momento em que o magistrado tentou localizar a jurisprudência citada. Não encontrou. Porque ela simplesmente não existia.

Em outro caso, o padrão se repetiu. A Justiça identificou dispositivos legais inexistentes, decisões incompatíveis com as bases oficiais e referências que jamais passaram por qualquer tribunal. O resultado não ficou restrito ao indeferimento dos pedidos: houve multa por litigância de má-fé, questionamentos éticos e envio de ofícios à Ordem dos Advogados do Brasil.

O que antes parecia uma hipótese distante já chegou aos tribunais brasileiros. E acendeu um alerta que vai muito além do uso inadequado de tecnologia. Afinal, a Inteligência Artificial não está apenas acelerando o acesso à informação jurídica. Ela começa a interferir na forma como o próprio conhecimento jurídico é produzido, validado e disseminado.

Nos últimos meses, decisões da Justiça Federal do Paraná, do Tribunal Regional do Trabalho da 2ª Região e do Tribunal Superior do Trabalho registraram situações em que petições apresentaram jurisprudência inexistente, possivelmente gerada por ferramentas de Inteligência Artificial sem supervisão adequada. Em alguns casos, magistrados destacaram expressamente a necessidade de revisão humana rigorosa do conteúdo produzido por IA.

O fenômeno já ganhou até nome técnico: “alucinação de IA”. Trata-se de quando sistemas geram informações plausíveis na forma, mas incorretas no conteúdo. O problema é que, no Direito, a aparência de precisão pode ser tão perigosa quanto o erro em si.

O Direito não funciona em linha reta

“Em um sistema jurídico complexo e dinâmico como o brasileiro, a simplificação do Direito por meio de Inteligência Artificial só é possível até um ponto bastante limitado”, afirmam Fábio Pereira e Giulia Volante, respectivamente sócio e advogada da área de Direito Digital, Inovação e Propriedade Intelectual do Veirano Advogados.

Segundo eles, o principal risco está justamente na falsa sensação de completude. “Fora desse campo mais objetivo, o risco de comprometer a aplicação prática da resposta é quase certo”, afirmam.

A analogia utilizada pelos especialistas ajuda a explicar o problema: usar IA para responder questões jurídicas pode se assemelhar a ler apenas o primeiro resultado de uma busca online. Funciona como ponto de partida, mas dificilmente contempla todas as variáveis que influenciam a aplicação concreta da norma.

E isso importa porque o Direito não opera de forma linear.

“Existe um risco real de produzir uma leitura linear de um sistema que, na prática, é interpretativo e contextual”, explicam Thais Matallo, sócia, e Giovanna Leonhardt, advogada de contencioso e arbitragem com LL.M. pela New York University, do Machado Meyer Advogados.

Para elas, a simplificação pode ampliar o acesso à informação jurídica, mas se torna problemática quando substitui a análise jurídica propriamente dita. “Ao transformar o Direito em respostas genéricas ou ‘receitas de bolo’, há comprometimento da aplicação prática.”

Na avaliação das especialistas, o risco cresce justamente porque respostas automatizadas tendem a transmitir segurança. E, quanto mais objetiva e convincente parece uma resposta, menor tende a ser o questionamento sobre suas limitações.

A “ilusão de conhecimento” preocupa especialistas

Para Camila Gutierres, advogada do Jorge Advogados, o impacto da Inteligência Artificial vai além da produtividade. Segundo ela, a tecnologia começa a alterar a própria lógica de construção do conhecimento jurídico.

“As IAs jurídicas não são superficiais, mas ainda não conseguem lidar plenamente com a complexidade do sistema jurídico brasileiro”, afirma.

Na prática, isso acontece porque o ordenamento jurídico depende de interpretação, contexto e constante atualização normativa. Embora a IA consiga identificar padrões, sintetizar normas e organizar informações, ainda encontra limitações importantes quando precisa lidar com nuances específicas de casos concretos.

Mas, o ponto mais sensível, segundo Camila, talvez seja outro. “Parte do processo de construção do conhecimento passa a ser terceirizada. O advogado deixa de construir integralmente uma linha de raciocínio e passa a selecionar, adaptar e validar respostas pré-sintetizadas.”

Essa mudança, embora traga ganhos evidentes de eficiência, também levanta riscos relevantes. Entre eles, o empobrecimento do pensamento jurídico, a redução da diversidade argumentativa e a perda de profundidade analítica.

Camila chama esse fenômeno de “ilusão de conhecimento”. Ou seja: a sensação de domínio sobre determinado tema sem que exista, de fato, compreensão aprofundada sobre ele.

Para o consumidor, o impacto também é direto; ainda que menos visível. À medida que respostas jurídicas passam a circular com aparência de precisão e autoridade, cresce o risco de decisões baseadas em interpretações incompletas ou equivocadas. Em um ambiente em que a informação chega mais rápido do que a capacidade de validá-la, confiança e compreensão deixam de caminhar necessariamente juntas.

Advogado deixa de ser autor e vira curador

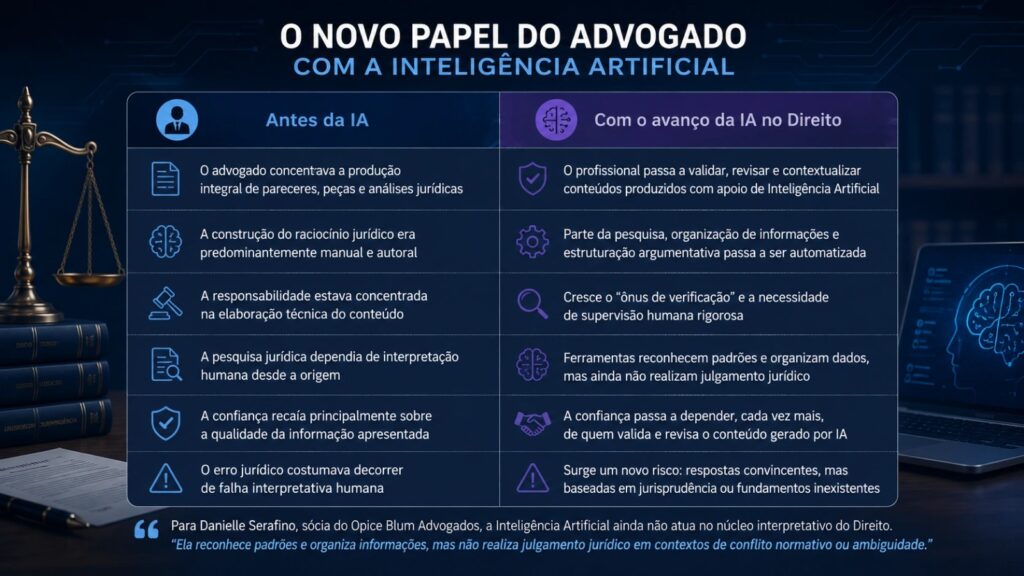

A transformação também muda o papel dos profissionais do Direito.

Para Danielle Serafino, sócia do Opice Blum Advogados, a Inteligência Artificial ainda não atua no núcleo interpretativo do Direito. “Ela reconhece padrões e organiza informações, mas não realiza julgamento jurídico em contextos de conflito normativo ou ambiguidade.”

Na prática, isso desloca o centro da atuação jurídica. O advogado deixa de ser apenas quem produz conteúdo (pareceres, peças e análises) e passa a assumir uma função mais estratégica: validar, contextualizar e revisar aquilo que a tecnologia ajuda a construir.

Esse novo cenário amplia o chamado “ônus de verificação”. Quanto mais ferramentas automatizam etapas da pesquisa, da redação e da organização de informações, maior se torna a necessidade de revisão crítica e supervisão humana.

E isso já aparece dentro dos próprios tribunais. Em decisões recentes, magistrados passaram a reforçar que o uso de Inteligência Artificial não afasta a responsabilidade do advogado sobre a veracidade das informações apresentadas em juízo. Pelo contrário: a tecnologia aumenta a necessidade de checagem.

No fim, a confiança deixa de estar apenas na informação e passa a depender de quem a valida.

Entre democratização e responsabilidade

Do ponto de vista das plataformas, o desafio está em equilibrar acessibilidade e rigor técnico.

Mohara Coimbra, legal expert manager do Jusbrasil, acompanha de perto essa transformação. À frente do desenvolvimento do Jus IA, ela defende que a Inteligência Artificial deve funcionar como ferramenta de apoio, e não como substituta da análise jurídica.

“A Inteligência Artificial precisa estar ancorada em fontes verificáveis e em curadoria humana”, afirma.

Segundo ela, o equilíbrio depende de transparência, rastreabilidade e clareza sobre os limites da resposta apresentada. Mais do que entregar informação rápida, a tecnologia precisa permitir que o usuário compreenda como aquela resposta foi construída.

Nesse contexto, Mohara reforça que democratizar o acesso ao Direito não significa simplificar excessivamente a interpretação jurídica. O desafio está justamente em tornar o conteúdo mais acessível sem eliminar as nuances que fazem parte do sistema jurídico.

Quando a resposta convence (mas engana)

Casos semelhantes aos registrados no Brasil também vêm sendo discutidos em outros países. Em comum, todos revelam o mesmo ponto de tensão: a capacidade da Inteligência Artificial de produzir respostas tecnicamente convincentes, ainda que incorretas.

E talvez esse seja o aspecto mais delicado dessa transformação. O problema não está apenas no erro. Está na forma como ele se apresenta.

No Direito, uma resposta bem escrita, estruturada e aparentemente fundamentada pode ser suficiente para convencer profissionais, consumidores e até operadores do sistema de Justiça.

Por isso, o debate já não gira apenas em torno da eficiência da Inteligência Artificial. Segundo os especialistas, a discussão agora envolve confiança, responsabilidade e validação. No fim, a questão não é se a tecnologia pode auxiliar o Direito. Mas se, diante de respostas cada vez mais convincentes, ainda sabemos reconhecer quando elas não são suficientes.