Recentemente, um vídeo do presidente dos Estados Unidos, Joe Biden, foi compartilhado no Facebook descrevendo-o como pedófilo. O conteúdo não era verídico, mas uma edição chamada “deepfake”, que consiste em criar narrativas falsas de forma ultra realista usando rosto e voz de pessoas famosas. Além desse, um outro caso mais recente foi o de Tom Hanks, que teve a tecnologia seu usada em uma propaganda. O ator de Hollywood usou o Instagram para alertar os seguidores de que ele não tinha ligação nenhuma com a marca que usou sua imagem sem autorização.

O que preocupa Mark Zuckerberg, dono da Meta, é que o vídeo de Biden não foi removido do Facebook pelos moderadores, e continua a ganhar visibilidade até hoje na rede social. Isso chamou a atenção do Conselho Supervisor da companhia do Vale do Silício para debater novas políticas contra essas edições de mídia que estão causando uma nova onda de desinformação, principalmente com o crescimento exponencial do acesso à Inteligência Artificial, ferramenta que é responsável, na maioria das vezes, por criar esse tipo de conteúdo.

Porém, não é só a imagem de políticos e famosos que é prejudicada pela nova tecnologia. Os consumidores do mundo todo podem ser lesados ao acreditarem nas mídias fraudulentas criadas por hackers ou empresas de má fé, como explica Jonathan Arend, especialista em cibersegurança da keeggo, consultoria de tecnologia.

Para Jonathan, as deepfakes são grandes responsáveis por muitas fraudes. “Elas representam uma ameaça à segurança dos usuários em redes sociais, pois podem ser usadas para manipular dados e criar desinformação, difamando indivíduos”, começa. “Além disso, permitem a disseminação de campanhas de phishing envolvendo técnicas de Engenharia Social, abrindo caminho para incidentes de extorsão, chantagem e, em casos mais graves, até mesmo sequestros”, completa.

Caso de deepfake nacional

No Brasil, um caso recente de uso de IA para recriar rosto e voz de uma pessoa foi no comercial da Volkswagen, que mostrou Elis Regina (morta há 41 anos), contracenando com a filha Maria Rita. A campanha é uma comemoração dos 70 anos da marca, mas muitos consumidores não gostaram da homenagem. O Conar (Conselho Nacional Auto Regulamentação Publicitária) chegou a instaurar um processo ético de apuração da propaganda, mencionando queixas dos clientes sobre “a ética do uso de inteligência artificial para trazer uma pessoa que morreu de volta à vida”, além de, segundo o órgão, “a possibilidade de tal uso causar confusão entre ficção e realidade para alguns, principalmente crianças e adolescentes”.

O advogado responsável pela denúncia foi Gabriel de Britto Silva, que apontou a necessidade da “limitação do uso da IA” na publicidade e o estabelecimento de diretrizes para o seu uso. “A emoção veio na mesma proporção do desconforto. Tal fato permite reflexões sobre questões de natureza ética, já que se está diante de pessoa humana falecida e que não pode reivindicar o uso da própria imagem. Não se sabe sequer se viva fosse, a Elis autorizaria a imagem, ainda mais para fabricante de automóveis e para fins estritamente comerciais”, diz Gabriel no documento.

Combatendo as deepfakes

Ainda não existe regulamentação específica para as essas imagens geradas artificialmente, mas após o caso de Joe Biden no Facebook, o assunto começou a ser debatido entre grandes executivos da tecnologia. Porém, não é um trabalho exclusivo deles. Muito do combate a esse tipo de fraude depende do consumidor. “Essa iniciativa deve ser acompanhada por esforços de reeducação dos usuários em relação ao uso responsável das diversas tecnologias disponíveis no mercado”, explica Jonathan. O especialista ainda acrescenta que se uma das partes não cooperar, não adianta. “O trabalho conjunto de reguladores, empresas de tecnologia e conscientização do público desempenha um papel crucial na mitigação do impacto dos deepfakes nas redes sociais.”

Identificando deepfakes

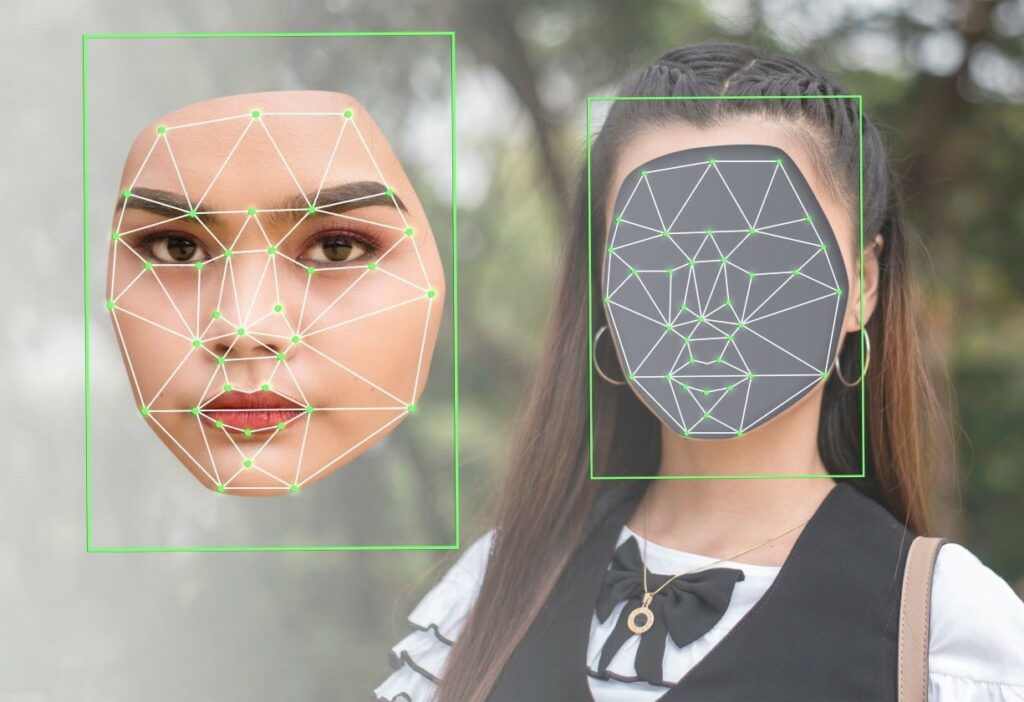

Mesmo essas manipulações de áudio e vídeo sendo quase perfeitas, ainda é possível identificá-las – mas é preciso ter vontade e não se deixar levar por qualquer informação que elas estiverem disseminando. De acordo com Jonathan, é aconselhável seguir os seguintes passos:

- Pesquise a fonte do material, validando se outros veículos confiáveis confirmam sua veracidade;

- Observe as inconsistências nos reflexos, na iluminação e no contexto do conteúdo do vídeo;

- Utilize ferramentas que detectam proativamente deepfakes;

- Preste atenção nas imperfeições visuais e auditivas dessas mídias, pois estes são fortes traços de que o conteúdo é manipulado.

+ NOTÍCIAS

CEOs e IA: abraçá-la ou ser deixado para trás?

IA para crianças: vale a pena para brincar e aprender