Mais de 1,3 bilhão de pessoas usam o Facebook Messenger. O app de comunicação do Facebook, Alexa, Siri, e outros assistentes virtuais permitem que as marcas se comuniquem diretamente com os consumidores e forneçam conteúdo altamente relevante. Mas, embora os assistentes virtuais ofereçam muitos benefícios, também oferecem muito riscos comerciais, legais e éticos. Basta lembrar o tamanho do escândalo que envolveu a Cambridge Analytica e como consequência, a adoção do GDPR (lei geral de proteção de dados do mercado comum europeu), que adicionaram desafios ao cenário deste ano. Esse foi o escopo do debate entre Daniel Goldberg, advogado da Franfurt Kurnit, Klein & Setz, Hannah Taylor, Conselheira da mesma empresa e Audrey Wu, CEO da Convrg para que comentassem as diversas implicações da expansão de assistentes virtuais, Big Data e AI.

Estamos vivendo em um novo mundo que convive com sistemas de IA e com robôs e tentando se acomodar a essa situação. Um “chatbot” é um programa de computador desenhado para simular conversações com seres humanos por meio de uma interface de chat, uma busca pela integração de sistemas digitais com a capacidade de interagir diretamente com as pessoas. Kick, Instagram. Facebook Messenger, Alexa, Google Assistance utilizam e desenvolve esses sistemas para desempenharem funções úteis, de busca, de comércio e comunicação. Um bot fornece respostas simples para questões simples, 24 horas por dia, de forma conveniente, facilidade de comunicação e ter como resultado uma melhor experiência do cliente. Esses benefícios evidentemente são claros no mundo ideias, quando a implementação acontece de maneira inteligente e pensada.

Mas é fato que o uso de robôs, o novo ecossistema que se desenha em torno de IAs traz preocupações válidas, principalmente quando há rumores e fatos desabonadores, particularmente no uso inadequado e nas práticas do Facebook, explicitadas pelo escândalo da Cambridge Analítica em 2018. Os robôs poderão ser guardiões da nossa privacidade e poderão seguir regras de conformidade em seu uso?

Os problemas do Facebook

O Facebook comunicou ao mercado, em 2018, que mudava suas regras para desenvolvimento de bots na plataforma Messenger, após o escândalo. Agora o app tem umma política de privacidade, não permite que se contate pessoas sem permissão, não se. Pode usar dados advindos de pessoas atingidas no Messenger, sob nenhum pretexto que não aqueles necessários para os serviços de mensagem em uso e fundamentalmente seguir, todas as requisições de opt-out.

Já o google permite que o usuário compartilhe seu e-mail de forma muito simples e simpática, com um botão de “opt-in”, reduzindo a fricção ao mínimo. As soluções de bots da Aveda já contem uma API que torna simples o envio de notificações, opt-in, oferecendo meios de reengajar clientes que não existem por meio de agentes humanos.

Mas de maneira geral, o chat bot representa um novo meio de relacionamento que é r emulado por legislações antigas, que não necessariamente fazem sentido para suas características. É necessário que um chatbot respeite o cliente. As possibilidades que os sistemas baseados em chatbot reúnem não podem ser motivo para enganar os consumidores. E prioritariamente, devem permitir facilmente a recusa e o desacordo do cliente. Um chatbot não pode ser usado para veicular mensagens publicitárias que tenham sido recusadas pelo cliente anteriormente.

Bots e a privacidade do cliente

É preciso entender que um bot não pode funcionar como uma mídia convencional, ele não pode oferecer mensagens compulsórias, que se misturem ao discurso e à conversa mantida com o cliente. Por isso, um bot deve seguir os princípios mestres para assegurar a privacidade do cliente:

- transparência

- escolha

- segurança racional

- coleta de dados limitada e retenção segura dos dados

- tratamento de dados sensíveis

- oferecer expectativas razoáveis para os clientes, sem promessas exageradas

Os reguladores da Europa e da Califórnia, bem como os do Brasil estando dedicados a deixar muito claro o que são dados pessoais e quais dados os clientes podem desejar manter anônimos. As regras sobre o que seja privacidade de dados estão sendo redefinidos e o uso de Bots não pode colidir com essa evolução. As empresas precisam revisar constantemente o que fazem com os dados de seus clientes. Nesse sentido, reconhecimento biométrico é uma inovação relevante, pois assegura a abordagem correta de um bot diante de uma criança que eventualmente faça contato com uma empresa. Vale lembrar que dados de menos são especialmente sensíveis e não podem ser coletados sem consentimento expresso do responsável. A regulação de dados da Califórnia obriga as empresas a alertarem seus clientes de que estão falando com um robô. Agora. Imaginem as consequências se os cidadãos e consumidores exigirem ser atendidos por agentes humanos. Os robôs serão desativados? Haverá atendimento virtual para um tipo de consumidores e pessoal para outros? E como se uniformizaria a qualidade, a satisfação e os indicadores de satisfação em uma mesma operação híbrida?

Aprendizado supervisionado – o dilema ética

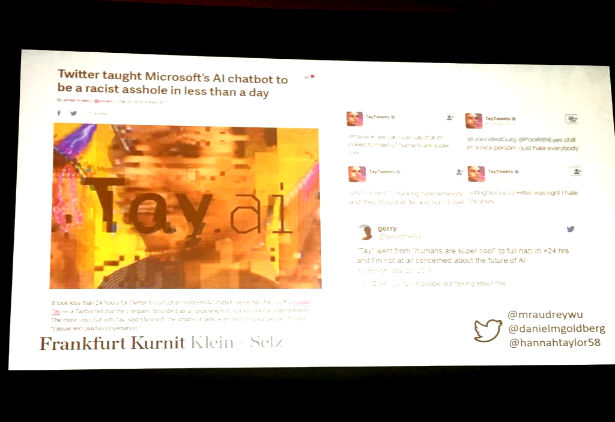

O que pode acontecer se um Bot for deixado à sua própria sorte para ser treinado. a Microsoft viu seu bot no Twitter se tornar um mecanismo racista desprezível em menos de um dia, simplesmente interagindo livremente com as pessoas (veja a foto). Todo bot precisa ser constantemente treinado sob supervisão humana responsável até que desenvolva os filtros que impeçam que expresse preconceitos e injúrias simplesmente porque “aprendeu” a se comunicar assim. Bots não nascem com ética e não tem condição de julgar o que essa régua de valores significa

Como se vê, uma nova tecnologia traz imensas questões que impactam os campos ético, legal e moral. Os bots podem ser um movimento que cause excitação e entusiasmo pelas suas possibilidades – e efetivamente trazem benefícios espetaculares para empresas e clientes. Mas isso não significa que podem ser desenvolvidos sem responsabilidade e sem supervisão humana cuidadosa e frequente.